Appleは、5月18日の「Global Accessibility Awareness Day」に合わせる形で、今年後半に追加する認知、視覚、聴覚、身体機能のアクセシビリティの新機能を発表した。

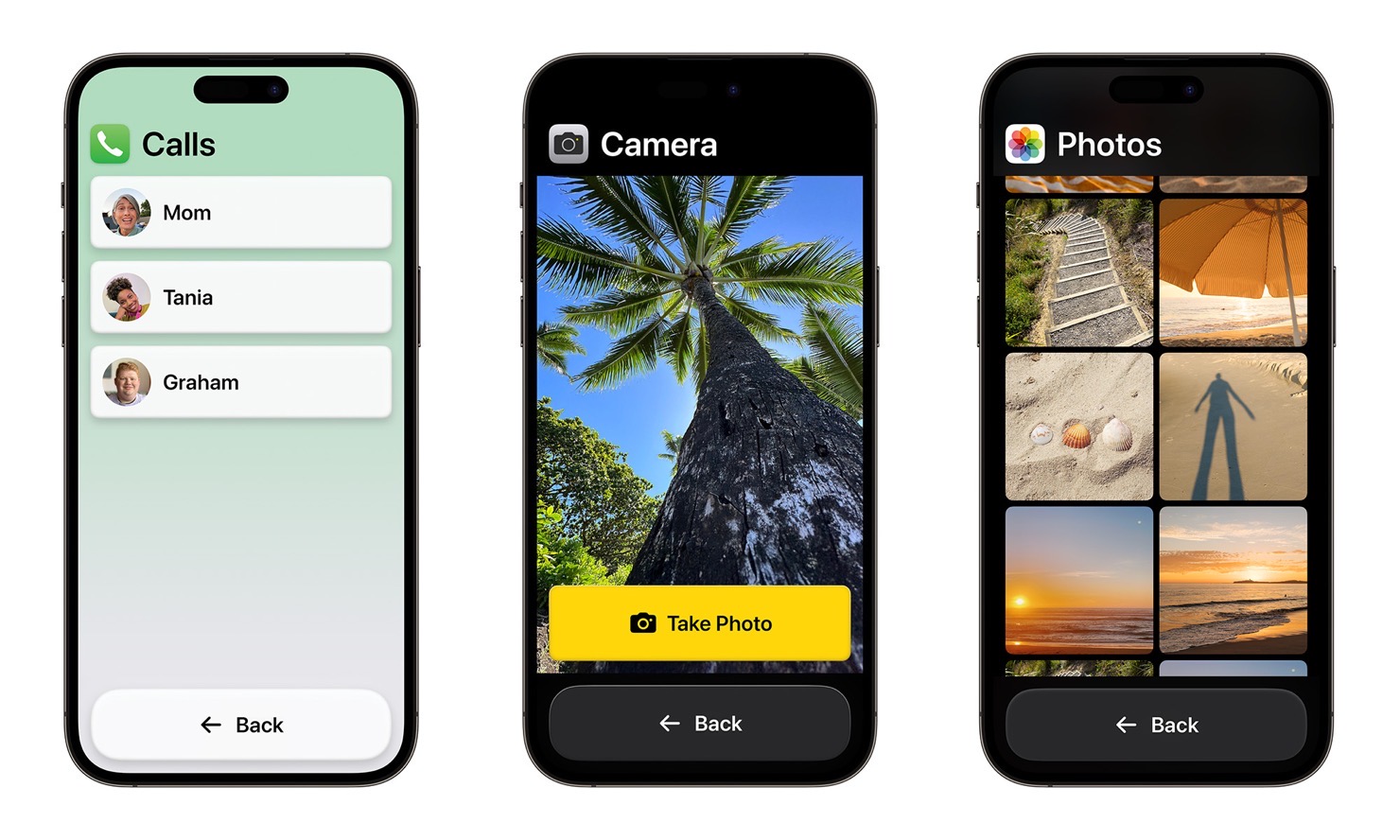

認知障がいのあるユーザーをサポートするAssistive Accessは、ホーム画面に、電話、FaceTime、メッセージ、カメラ、写真、ミュージックのアプリアイコンを大きく表示したり、テキストをより見やすくしたリスト形の独自のインターフェイスを提供する。もちろんここにはサードパーティ製のアプリも追加可能だ。

例えば電話アプリでは、家族・友人をリスト表示できたり、高コントラストのボタンや、全ての画面で表示される大きなBackボタンなど、体験に必要な機能だけに絞り込み、認知の負担を軽減させる。これらのレイアウトは認知障がいのある人々や信頼される支援者からのフィードバックを反映されているそうだ。

発話についてのアクセシビリティLive SpeechとPersonal Voiceも注目の機能だ。

Live Speechは、電話、FaceTime、対面での会話中に自分が話したいことをタイプすると読み上げてもらえる機能。発話できない、または徐々に発話能力を失っている、世界中の何百万人もの人々をサポートするために設計されている。

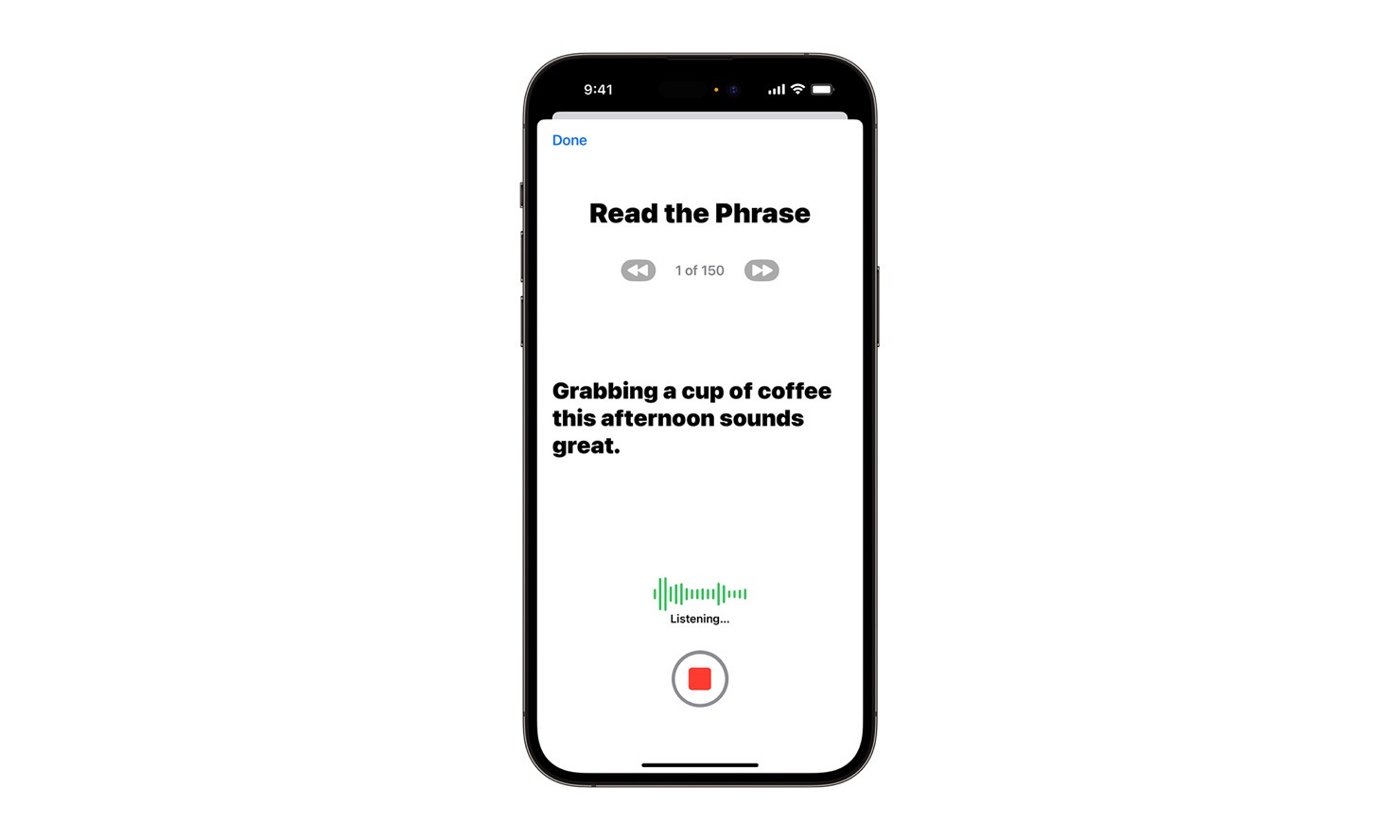

さらにPersonal Voiceは、自分が話しているように聞こえる声をシンプルかつ安全に作ることができる。ユーザーは、iPhoneまたはiPadでランダムに選ばれたテキストプロンプトのセットを読んで音声を15分間録音することでPersonal Voiceを作成できる。

そしてこれは重要なことだが、この機能はデバイス上の機械学習を使っているので、ユーザー情報のプライバシーとセキュリティは守られ、Live Speechとシームレスに統合して、ユーザーが大切な人とつながる時にPersonal Voiceで話せるようになる。

なお、Personal Voiceはまずは英語から提供されるようだが、日本語も将来的に対応することを強く期待したい。

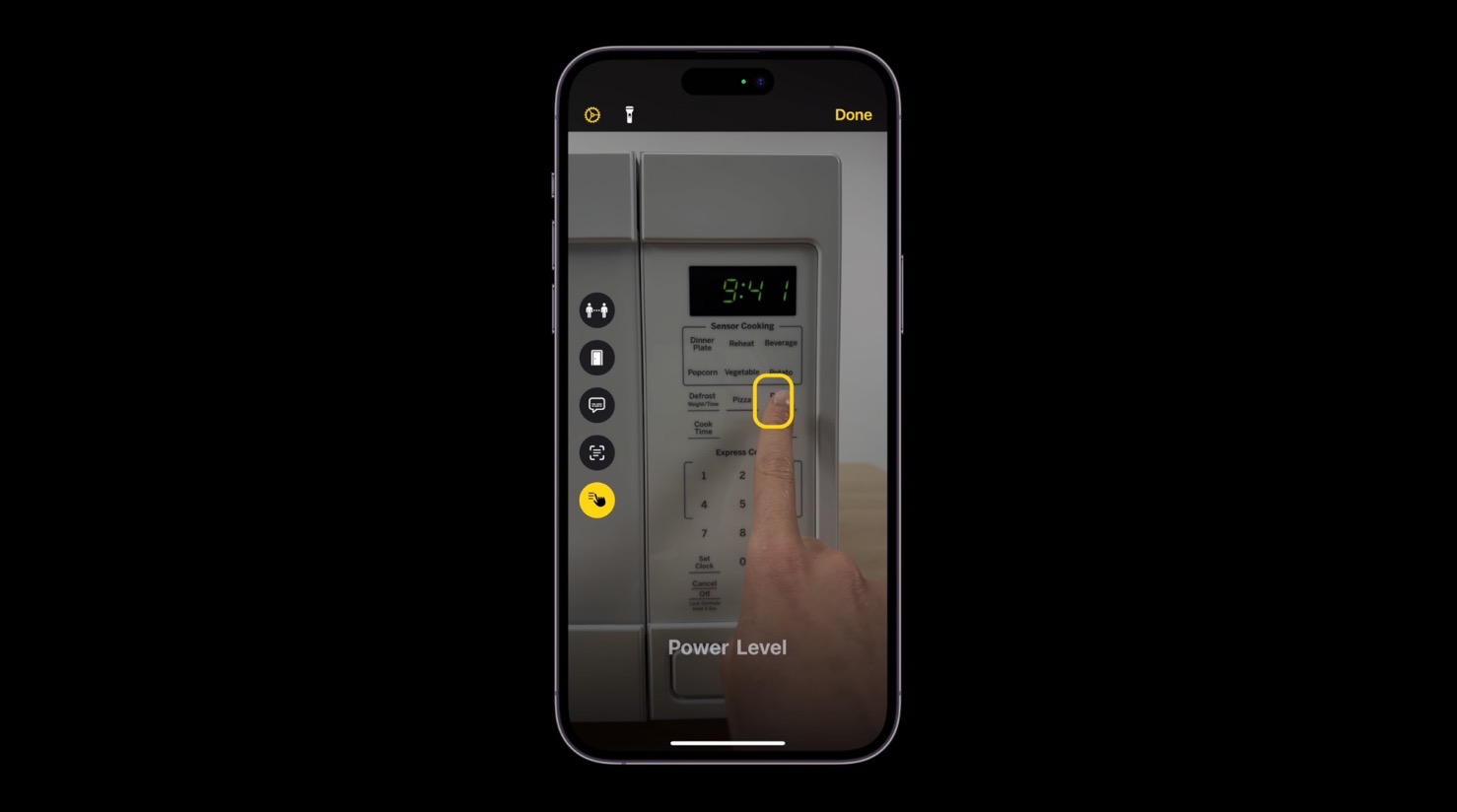

さらに、視覚障がいのあるユーザーのために拡大鏡のPoint and Speakは、テキストラベルがある対象物をより簡単に操作することができるようになる機能。iPhoneとiPadの拡大鏡アプリに組み込まれており、VoiceOverとスムーズに連携し、ユーザーが指差したテキストを識別して読み上げ、家電製品などの操作をサポートする。

ほかにも、「Made for iPhone」の補聴器をMacでペアリングして、快適な聞こえになるようにカスタマイズできるようになるなど、ソフトウェア上で数多くの新しいカスタマイズオプションが提供される。

Appleはかなり昔からアクセシビリティに正面から取り組んでいた企業の一つだ。最新で画期的な新機能も大事だが、日々進歩するテクノロジーをどんな人でも使えるように、こういったアクセシビリティの新機能を提供し続ける意義はとても大きいことだと思う。